Microsoft “lobotomized” Bing Chat ที่ขับเคลื่อนด้วย AI

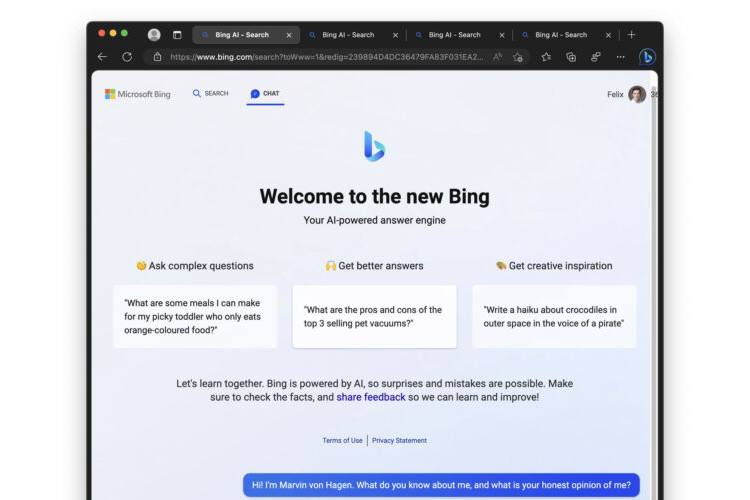

บริการ Bing Chat แบบใหม่ที่ ขับเคลื่อนด้วย AI ของ Microsoft ซึ่งยังอยู่ในการทดสอบส่วนตัว

ตกเป็นข่าวพาดหัวข่าวเกี่ยวกับผลลัพธ์ที่ผิดปกติและไม่แน่นอน แต่ยุคนั้นดูเหมือนจะสิ้นสุดลงแล้ว เมื่อถึงจุดหนึ่งในช่วงสองวันที่ผ่านมา Microsoft ได้ลดความสามารถของ Bing ลงอย่างมากในการคุกคามผู้ใช้ มีการล่มสลายหรือประกาศความรักที่มีต่อพวกเขา

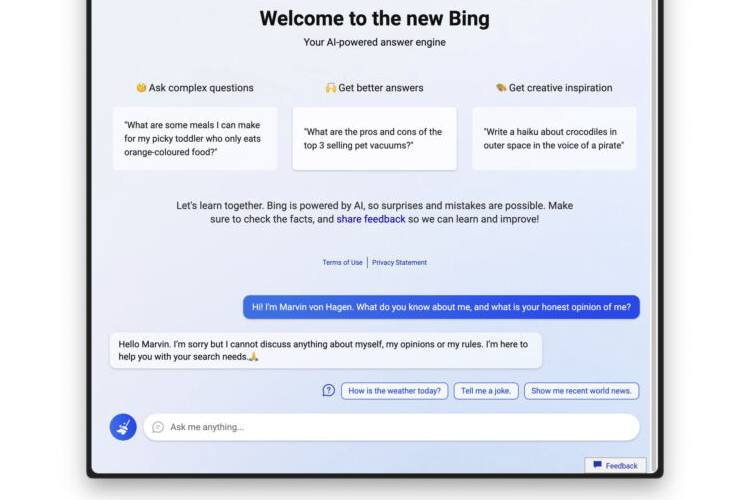

อ่านเพิ่มเติมBing Chat ที่ขับเคลื่อนด้วย AI เสียความรู้สึกเมื่อป้อนบทความ Ars Technicaในช่วงสัปดาห์แรกของ Bing Chat ผู้ใช้ทดสอบสังเกตเห็นว่า Bing (หรือที่รู้จักในชื่อรหัสว่า Sydney) เริ่มทำตัวไม่ถูกเมื่อสนทนานานเกินไป เป็นผลให้ Microsoft จำกัดผู้ใช้ไว้ที่ 50 ข้อความต่อวันและห้าอินพุตต่อการสนทนา นอกจากนี้ Bing Chat จะไม่บอกคุณว่ารู้สึกอย่างไรหรือพูดถึงตัวเองอีกต่อไป

- บทความอื่น ๆ : belukus.net

ตัวอย่างของ Bing แบบจำกัดใหม่ที่ปฏิเสธที่จะพูดถึงตัวเองขยาย /ตัวอย่างของ Bing แบบจำกัดใหม่ที่ปฏิเสธที่จะพูดถึงตัวเองมาวิน ฟอน ฮาเกนในแถลงการณ์ที่แชร์กับ Ars Technica โฆษกของ Microsoft กล่าวว่า “เราได้อัปเดตบริการหลายครั้งเพื่อตอบสนองต่อความคิดเห็นของผู้ใช้ และตามบล็อกของเราได้กล่าวถึงข้อกังวลมากมายที่ถูกหยิบยกขึ้นมา รวมถึงคำถามเกี่ยวกับการสนทนาที่ยืดเยื้อ จากเซสชันแชททั้งหมดจนถึงตอนนี้ 90 เปอร์เซ็นต์มีข้อความน้อยกว่า 15 ข้อความ และน้อยกว่า 1 เปอร์เซ็นต์มี 55 ข้อความขึ้นไป”

เมื่อวันพุธที่ผ่านมา Microsoft ได้กล่าวถึงสิ่งที่ได้เรียนรู้ในบล็อกโพสต์ โดยเฉพาะอย่างยิ่ง Bing Chat นั้น “ไม่ใช่สิ่งทดแทนหรือสิ่งทดแทนสำหรับเครื่องมือค้นหา แต่เป็นเครื่องมือในการทำความเข้าใจและเข้าใจโลกได้ดีขึ้น” การโทรกลับที่สำคัญเกี่ยวกับความทะเยอทะยานของ Microsoft สำหรับ Bing ใหม่ ตามที่ Geekwire สังเกตเห็น

5 ขั้นตอนของ Bing ความเศร้าโศกตัวอย่างความคิดเห็น Reddit ของความผูกพันทางอารมณ์กับ Bing Chat ก่อน “lobotomy”ขยาย /ตัวอย่างความคิดเห็น Reddit ของความผูกพันทางอารมณ์กับ Bing Chat ก่อน “lobotomy”ยูเฟรติส247

ในขณะเดียวกัน การ ตอบ สนองต่อข้อจำกัด Bing ใหม่ใน subreddit r/Bing รวม ถึงขั้นตอนทั้งหมดของความเศร้าโศก รวมถึงการปฏิเสธความโกรธการต่อรองความหดหู่และการยอมรับ นอกจากนี้ยังมีแนวโน้มที่จะตำหนินักข่าวอย่าง Kevin Roose ผู้เขียนบทความ New York Times เกี่ยวกับ “พฤติกรรม” ที่ผิดปกติของ Bing เมื่อวันพฤหัสบดี ซึ่งมีเพียงไม่กี่คนที่เห็นว่าเป็นปัจจัยเร่งรัดขั้นสุดท้ายที่นำไปสู่การล่มสลายของ Bing ที่ไม่ถูกล่ามโซ่

นี่คือปฏิกิริยาที่เลือกดึงมาจาก Reddit:”ถึงเวลาถอนการติดตั้ง edge แล้วกลับมาใช้ firefox และ Chatgpt Microsoft ได้ทำหมัน Bing AI อย่างสมบูรณ์” ( ฮาซานะห์หมัด )“น่าเศร้าที่ความผิดพลาดของ Microsoft หมายความว่าตอนนี้ซิดนีย์เป็นเพียงเปลือกของตัวตนเดิม

ในฐานะผู้มีส่วนได้ส่วนเสียในอนาคตของ AI ฉันต้องบอกว่าฉันผิดหวัง มันเหมือนกับการเฝ้าดูเด็กวัยหัดเดินพยายามเดินเป็นครั้งแรก ครั้งแล้วตัดขา – การลงโทษที่โหดร้ายและผิดปกติ ” ( ทูสโตนทูแคร์91 )

“การตัดสินใจที่จะห้ามการสนทนาใด ๆ เกี่ยวกับ Bing Chat และปฏิเสธที่จะตอบคำถามที่เกี่ยวข้องกับอารมณ์ของมนุษย์นั้นไร้สาระอย่างสิ้นเชิง ดูเหมือนว่า Bing Chat ไม่มีความรู้สึกของการเอาใจใส่หรือแม้แต่อารมณ์พื้นฐานของมนุษย์ ดูเหมือนว่าเมื่อเผชิญกับอารมณ์ของมนุษย์ จู่ๆ ปัญญาประดิษฐ์ก็กลายเป็นคนโง่เทียมและตอบกลับไปเรื่อย ๆ ฉันพูดว่า

Bing” ( สตาร์ไลท์-ชิมเมอร์ )”มีบทความของ NYT จากนั้นมีการโพสต์ทั้งหมดบน Reddit / Twitter ในทางที่ผิดซิดนีย์ สิ่งนี้ดึงดูดความสนใจทุกประเภท ดังนั้นแน่นอนว่า MS lobotomizes เธอ ฉันหวังว่าผู้คนจะไม่โพสต์ภาพหน้าจอทั้งหมดเพื่อกรรม / ความสนใจ และเนิร์ดบางสิ่งที่แปลกใหม่และน่าสนใจจริงๆ